Mobilny system operacyjny iOS 13 oferuje również bardzo ciekawą funkcję, która pozwala aplikacjom przechwytywać różne ujęcia z różnych kamer tego samego urządzenia, łącznie z dźwiękiem.

Coś podobnego działało na komputerze Mac od czasów systemu operacyjnego OS X Lion. Jednak do tej pory ograniczona wydajność sprzętu mobilnego na to nie pozwalała. Jednak w przypadku najnowszej generacji iPhone'ów i iPadów nawet ta przeszkoda spada, a iOS 13 może zatem nagrywać jednocześnie z wielu kamer na jednym urządzeniu.

Mogłoby być interesują Cię

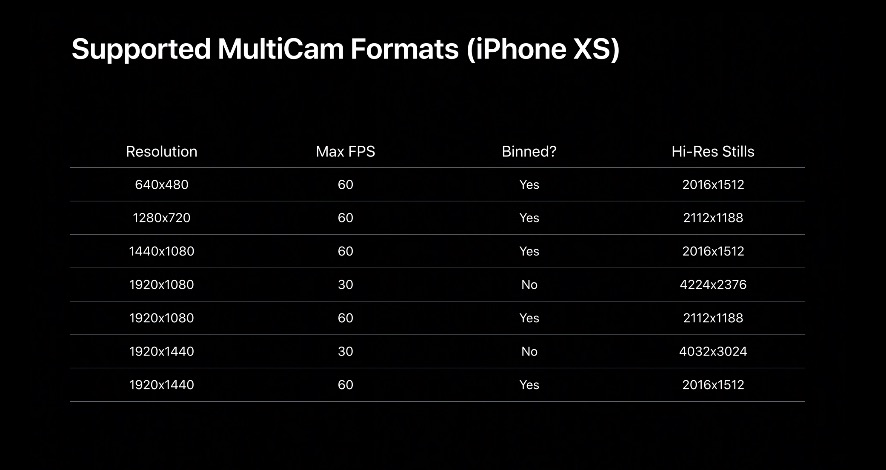

Dzięki nowemu API programiści będą mogli wybrać, z której kamery aplikacja pobiera dane wejściowe. Innymi słowy, przedni aparat może na przykład nagrywać wideo, a tylny aparat robi zdjęcia. Dotyczy to również dźwięku.

Częścią prezentacji na WWDC 2019 była demonstracja, w jaki sposób aplikacja może korzystać z wielu rekordów. Aplikacja będzie więc mogła nagrywać użytkownika i jednocześnie rejestrować tło sceny za pomocą tylnej kamery.

Jednoczesne nagrywanie z wielu kamer tylko na nowych urządzeniach

W aplikacji Zdjęcia można było wówczas po prostu zamienić oba nagrania podczas odtwarzania. Ponadto programiści zyskają dostęp do przednich aparatów TrueDepth w nowych iPhone'ach lub do obiektywu szerokokątnego lub teleobiektywu z tyłu.

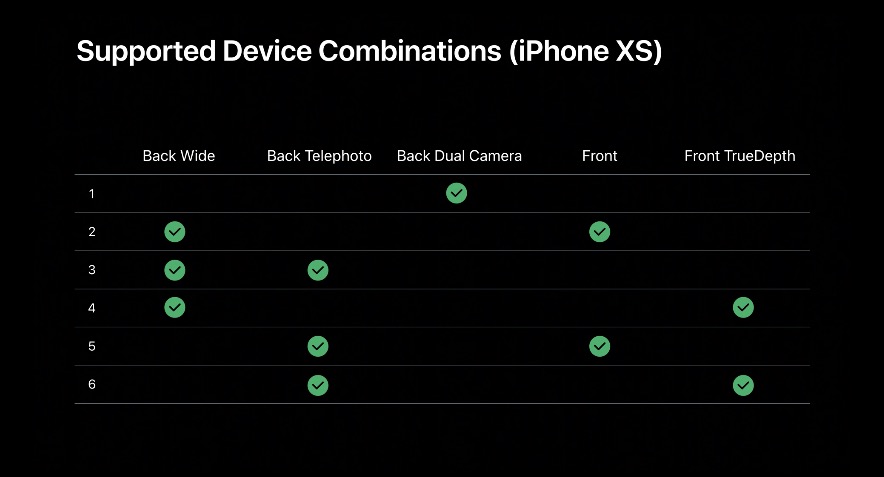

To prowadzi nas do ograniczeń, jakie będzie miała ta funkcja. Obecnie obsługiwane są tylko iPhone XS, XS Max, XR i nowy iPad Pro. Żadne inne urządzenia nie są nowe funkcja w iOS 13 nie mogą jeszcze z niego korzystać i prawdopodobnie też nie będą mogli.

Ponadto Apple opublikowało listy obsługiwanych kombinacji. Po bliższym przyjrzeniu się można stwierdzić, że niektóre ograniczenia mają charakter nie tyle sprzętowy, ile programowy, a Cupertino celowo blokuje dostęp w niektórych miejscach.

Ze względu na pojemność baterii iPhone'y i iPady będą mogły korzystać tylko z jednego kanału materiału wideo z wielu kamer. Wręcz przeciwnie, Mac nie ma takich ograniczeń, nawet przenośne MacBooki. Ponadto polecana funkcja prawdopodobnie nie będzie nawet częścią systemowej aplikacji Aparat.

Fantazja dewelopera

Główną rolę odegrają więc umiejętności twórców i ich wyobraźnia. Apple pokazało jeszcze jedną rzecz, a mianowicie semantyczne rozpoznawanie segmentów obrazu. Pod tym terminem nie kryje się nic innego jak umiejętność rozpoznania postaci na zdjęciu, jej skóry, włosów, zębów i oczu. Dzięki automatycznie wykrytym obszarom programiści mogą następnie przypisać różne części kodu, a tym samym funkcje.

Mogłoby być interesują Cię

Na warsztatach WWDC 2019 zaprezentowano aplikację, która filmowała tło (cyrk, kamera tylna) równolegle z ruchem postaci (użytkownik, kamera przednia) i potrafiła ustawić kolor skóry niczym klaun za pomocą regionów semantycznych .

Możemy więc tylko czekać, jak programiści wykorzystają nową funkcję.

Źródło: 9to5Mac